Basura digital

¿Está la IA deteriorando la calidad de internet?

La proliferación de la basura digital generada por IA está poniendo en jaque la calidad de los contenidos que vemos en internet, lo que desemboca en desinformación y falta de confianza por parte de los usuarios.

Artículo

Si quieres apoyar el periodismo de calidad y comprometido puedes hacerte socio de Ethic y recibir en tu casa los 4 números en papel que editamos al año a partir de una cuota mínima de 30 euros, (IVA y gastos de envío a ESPAÑA incluidos).

COLABORA2025

Artículo

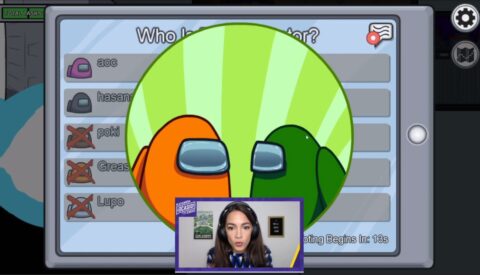

Aunque son muchos los usos beneficiosos que la inteligencia artificial nos ha traído, hay un fenómeno tan nocivo como inesperado que acompaña a la generalización de la IA generativa: el aumento masivo y descontrolado del contenido de baja calidad generado de manera artificial, comúnmente denominado «basura digital». Algunos ejemplos de este contenido son las sugerencias automáticas de Google carentes de lógica, como «añadir pegamento no tóxico» para hacer que el queso se pegue mejor a la pizza, como indica The New York Times, o los perfiles falsos con imágenes generadas con IA que proliferan en redes sociales.

La aparición del modelo Gemini de Google en mayo de 2024 no hizo más que acrecentar el fenómeno en Estados Unidos, debido a la función AI Overview que empezó a generar respuestas automáticas en vez de mostrar los enlaces pertinentes. Según expertos de la Universitat Oberta de Catalunya (UOC), la masificación de contenido implica algunos riesgos como la saturación o el ruido por contenido vacío, la desinformación o la crisis de confianza en internet.

«El principal riesgo es que internet se llene de “ruido”: textos vacíos, repetitivos o engañosos que ocultan la información útil», explica Antonio Pita Lozano, profesor de los Estudios de Informática, Multimedia y Telecomunicación de la UOC e investigador del grupo ICSO. Esta masificación dificulta encontrar contenido de valor merma la confianza, pues no sabemos si detrás del contenido hay un ser humano o una máquina soltando «frases bonitas pero vacías», añade.

¿Cuál es la solución para frenar esta avalancha de basura digital? Las plataformas pueden usar filtros automáticos, herramientas de detección de contenido duplicado o mecanismos de verificación de autoría y calidad, pero no es suficiente. Las inteligencias artificiales generativas evolucionan rápido, y cada vez es más difícil distinguir un contenido de calidad de la basura digital. Además, estas soluciones «no son mágicas», advierte el profesor de la UOC, por lo que es necesaria a aparición de una mayor regulación.

China y la Unión Europa han empezado a establecer regulaciones para controlar el contenido generado por IA

«Se está trabajando en normativas para poder establecer las reglas. Un ejemplo interesante es el de China, que ha establecido regulaciones para controlar el contenido generado por IA. Estas medidas incluyen la obligación de etiquetar claramente el contenido creado por inteligencia artificial y asegurar que los datos utilizados para entrenar estos modelos sean precisos y no infrinjan derechos de autor», explica Pita.

La Unión Europea ya ha adoptado medidas para frenar la inundación de contenido de baja calidad generado por IA. En 2024, Bruselas aprobó la Ley de Inteligencia Artificial (AI Act), que impone obligaciones de transparencia, como etiquetar el contenido sintético para advertir a los usuarios. Estados Unidos, por el contrario, aún carece de una regulación específica contra esta «contaminación digital», y se apoya principalmente en iniciativas voluntarias de la industria. Entre los enfoques emergentes comunes, destaca la exploración de marcas de agua digitales y sistemas de procedencia de contenido para identificar automáticamente el material generado por IA, con el objetivo de complementar las medidas regulatorias vigentes o en desarrollo.

Paradójicamente, y según indica Pita, la propia inteligencia artificial puede ser entrenada para detectar basura digital. Una IA bien empleada puede ayudarnos a comparar contenidos y detectar patrones sospechosos. Eso sí, «necesita reglas claras, éticas y un buen criterio humano detrás: si dejamos que la IA lo decida todo sola, el remedio puede ser peor que la enfermedad», explica el profesor.

¿Cómo afecta la IA a las redes sociales?

Pasamos mucho tiempo al día navegando por las redes sociales, y el aumento de contenido de baja calidad generado por IA ya ha empezado a afectar a nuestra experiencia. Así lo advierte Silvia Martínez Martínez, profesora de los Estudios de Ciencias de la Información y de la Comunicación de la UOC e investigadora del grupo GAME.

La saturación de basura digital genera una mayor sensación de pérdida de tiempo, al no encontrar el usuario contenidos de valor, pero también incertidumbre, confusión o, lo que es más peligroso, desinformación. El usuario puede percibir que está siendo utilizado para generar interacciones, lo que también lleva a un uso más comedido de internet. Todo esto crea «escepticismo respecto al contenido consumido», alerta Martínez.

Un análisis de Harvard Business Review alerta de la creciente crisis de confianza en internet

Un análisis reciente de Harvard Business Review alerta de que la expansión de contenido generado por inteligencia artificial está agravando la crisis de confianza en internet. La proliferación de basura digital no solo deteriora la calidad de la información disponible, sino que contribuye a una sensación de saturación y desconfianza entre los usuarios. La situación se ha visto agravada por los recortes en moderación humana en grandes plataformas como Meta, YouTube o X, que han reemplazado buena parte de sus equipos por sistemas automatizados incapaces de frenar la avalancha de basura digital.

El artículo señala que, a pesar de las regulaciones, la aplicación de las medidas de marcaje de contenido y filtración es desigual, y deja expuestas a las regiones que no forman parte de los grandes mercados como Estados Unidos o la Unión Europea. El desarrollo de los deepfakes y el volumen masivo de la basura incentivada por algoritmos está llevando a un crecimiento sin precedentes de la desinformación, lo que hace imprescindible un refuerzo en la alfabetización digital de los usuarios.

Aún está por ver cuál es la responsabilidad de las plataformas en lo relativo a este contenido. Silvia Martínez apunta que, aunque el contenido generado por IA pueda percibirse como irreal o poco útil, en algunos casos también logra captar la atención de ciertos usuarios. Esto puede llevar a que las plataformas, aun identificando que este contenido está generado por una IA, los sigan promocionando para maximizar la interacción. «Será interesante ver cómo se logra el equilibrio entre las medidas adoptadas y los intereses cruzados», concluye.

COMENTARIOS