La transparencia como brújula en la inteligencia artificial

El avance acelerado de la inteligencia artificial trae consigo oportunidades inmensas, pero, también una pregunta que resuena cada vez con más fuerza: ¿cómo podemos confiar en sistemas que, en muchos casos, funcionan como cajas negras?

Artículo

Si quieres apoyar el periodismo de calidad y comprometido puedes hacerte socio de Ethic y recibir en tu casa los 4 números en papel que editamos al año a partir de una cuota mínima de 30 euros, (IVA y gastos de envío a ESPAÑA incluidos).

COLABORA2025

Artículo

El avance acelerado de la inteligencia artificial trae consigo oportunidades inmensas, pero, también una pregunta que resuena cada vez con más fuerza: ¿cómo podemos confiar en sistemas que, en muchos casos, funcionan como cajas negras?

La palabra clave es transparencia: la capacidad de explicar, documentar y comprender los procesos de decisión de la IA en un lenguaje accesible para, y esto es crítico, quienes se ven afectados. En este sentido, la transparencia es la brújula que nos permite navegar en un mar de datos, modelos y decisiones automatizadas.

¿Qué significa ser transparente en IA?

Ser transparente se suele relacionar con «abrir» un algoritmo. Pero eso no es ni siquiera la punta del iceberg. No podemos interpretar un modelo matemático tan complejo como los que conforman la IA actual ni aunque dispusiéramos de todo el código fuente… además de que esto entraría en conflicto con leyes de propiedad intelectual o de secreto industrial.

En realidad, la transparencia en la inteligencia artificial se centra en temas como explicar con claridad qué datos se han utilizado y con qué finalidad, indicar qué tipo de modelo se emplea (una red neuronal profunda como las que componen los nuevos modelos de IA no se entiende igual que un árbol de decisión que es prácticamente autoexplicable). Así como, reconocer limitaciones: sesgos posibles, márgenes de error, escenarios en los que el sistema no debería usarse. Y, sobre todo, poner toda esta información en formatos comprensibles: fichas técnicas, etiquetas de confianza, resúmenes ejecutivos para directivos, o materiales divulgativos para la ciudadanía. En definitiva, se trata de pasar de la opacidad técnica a una comprensión socialmente útil.

La transparencia en la inteligencia artificial se centra en temas como explicar con claridad qué datos se han utilizado y con qué finalidad

La transparencia en IA ni es un capricho ético ni una moda académica. Es un requisito, legal en muchos países, para generar confianza, proteger derechos, cumplir con la regulación e impulsar la innovación. Veámoslo punto por punto. Necesitamos generar confianza, porque ningún sistema se adopta de manera masiva si la sociedad lo percibe como peligroso o injusto. Por tanto, la transparencia es base para la competitividad y el uso público de la IA.

Necesitamos proteger derechos, pues las decisiones opacas pueden discriminar a colectivos enteros sin que estos tengan herramientas para reclamar. Cumplir con la regulación, pues en Europa, Brasil o Corea del Sur, las nuevas regulaciones exigirán niveles crecientes de transparencia en función del riesgo del sistema. E impulsar la innovación, pues, lejos de frenar, la transparencia bien diseñada ayuda a las empresas a diferenciarse y a competir con calidad.

Europa está liderando este debate con su reglamento de IA, que establece que cuanto mayor sea el impacto de un sistema, mayor debe ser su grado de transparencia y explicabilidad. Esto se traduce en obligaciones como documentar datos de entrenamiento, facilitar auditorías o incluir información clara al usuario final.

Este marco se suma a iniciativas previas como el RGPD, que introdujo el llamado «derecho a la explicación», o las directrices de la OCDE y la UNESCO, que refuerzan la idea de una IA confiable y centrada en el ser humano. Además, el concepto de transparencia algorítmica empieza a aparecer en otras regulaciones tanto generales como sectoriales. La propia Unión Europea va a preparar, junto con diferentes expertos, un nuevo código de buenas prácticas, esta vez sobre transparencia para sistemas de IA generativa.

Pero la regulación, por sí sola, no basta. Necesita de instrumentos prácticos que traduzcan principios generales en procedimientos operativos.

En este punto, vale la pena citar un ejemplo cercano: el Certificado de Transparencia Algorítmica impulsado desde Adigital. Lejos de ser un sello cosmético, desde el principio se posiciona como un marco de referencia que ayuda a empresas y organizaciones a evaluar hasta qué punto sus sistemas cumplen con criterios claros de transparencia y explicabilidad. Ha sido reconocido por la OCDE y ya ha sido adoptado por compañías de distintos sectores.

La lógica es sencilla: si certificamos la calidad de un producto alimentario o la seguridad de una instalación eléctrica, ¿por qué no certificar también la transparencia de un algoritmo que puede decidir sobre una hipoteca, una beca académica o un tratamiento médico?

No obstante, conviene no idealizar. La transparencia tiene límites, técnicos, competitivos y prácticos. De nada nos sirve ser demasiado transparente y revelar secretos industriales o afectar a la propiedad intelectual ni abrumar con demasiada información. Ahí es donde reside el reto, en encontrar un equilibrio entre una transparencia suficiente para proteger derechos y mantener la confianza sin ahogar

la innovación ni crear burocracia inútil.

Entonces, si la transparencia puede ser un arma de doble filo, ¿cómo avanzamos?

Como en la nutrición, es importante mantener un etiquetado claro y simplificado, con documentación más técnica en profundidad tan solo cuando sea necesario. Así como incluir desde un inicio mecanismos de documentación y explicabilidad. Pero, si tanto los desarrolladores, directivos y usuarios carecen de cultura digital, todo esfuerzo será en vano. Por eso mismo, es esencial apostar por una formación continua y abrir espacios de debate donde los distintos actores (empresas, reguladores, sociedad civil) debatan y definan qué significa, en la práctica, ser transparente.

En los próximos años veremos cómo la inteligencia artificial se convierte en una infraestructura tan básica como la electricidad o internet. Y en esa transición, la transparencia no es un accesorio: es la condición para que la IA sea adoptada de manera legítima y sostenible.

Habrá voces que adviertan de sus costes, de la dificultad técnica o de la lentitud regulatoria. Pero la experiencia demuestra que sin transparencia el precio a pagar es mayor: desconfianza, litigios, rechazo social.

La transparencia en IA no significa abrirlo todo, ni entenderlo todo, sino poner la luz suficiente para caminar con seguridad. Y, como toda brújula, no nos garantiza un viaje sin obstáculos, pero sí que avancemos en la dirección correcta.

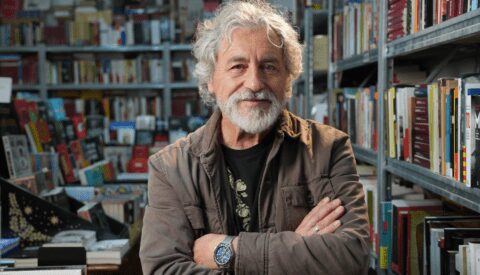

Justo Hidalgo es director de Inteligencia Artificial de Adigital (la Asociación Española de Economía Digital).

COMENTARIOS