Los modelos del mundo

La inteligencia artificial aprende la dinámica de los fenómenos sin interactuar con ellos, solamente procesando flujos de datos. Esto redefine el concepto de verdad.

Artículo

Si quieres apoyar el periodismo de calidad y comprometido puedes hacerte socio de Ethic y recibir en tu casa los 4 números en papel que editamos al año a partir de una cuota mínima de 30 euros, (IVA y gastos de envío a ESPAÑA incluidos).

COLABORA2026

Artículo

En su relato Del rigor en la ciencia, Jorge Luis Borges describe un Imperio donde el arte de la cartografía alcanzó tal perfección que el mapa terminó coincidiendo, punto por punto, con el tamaño del territorio. Hoy, la inteligencia artificial parece retomar esa ambición a través de los denominados «modelos del mundo». A diferencia de los sistemas que solo procesan lenguaje, estos nuevos motores aspiran a simular la física de la realidad misma. Nos encontramos ante una cartografía digital que ya no solo describe el entorno, sino que pretende suplantarlo mediante la simulación predictiva.

El salto de los datos a la comprensión del entorno

Para entender la revolución que suponen los modelos del mundo, debemos distinguir qué hace la IA actual. Los sistemas generativos de texto funcionan como bibliotecarios veloces que predicen la palabra más probable basándose en billones de ejemplos. Sin embargo, carecen de una comprensión ontológica: no «saben» qué es un objeto, cómo actúa la gravedad o por qué un cristal se fragmenta al impacto; solo conocen la sintaxis de esos eventos.

Los modelos del mundo pretenden construir un simulador interno similar a un motor de videojuegos que comprende las reglas de la causalidad

En cambio, los modelos del mundo pretenden construir un simulador interno similar a un motor de videojuegos que comprende las reglas de la causalidad. Este cambio es profundo: la máquina deja de ser un buscador de patrones lingüísticos para convertirse en un sistema que «imagina» el funcionamiento de la realidad. Al poseer una representación interna del entorno, la IA puede prever las consecuencias de una acción antes de ejecutarla en el plano físico, optimizando la toma de decisiones mediante una introspección algorítmica.

Los arquitectos del simulador: ¿quiénes proponen este cambio?

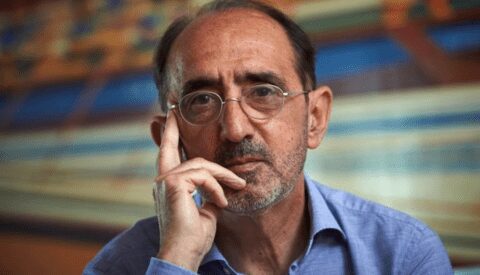

Esta transición hacia una inteligencia artificial dotada de «sentido común físico» está siendo liderada por un grupo selecto de instituciones y teóricos que buscan superar las limitaciones de los modelos de lenguaje actuales. Entre los proponentes más destacados se encuentra Yann LeCun, Premio Turing y figura central en Meta (FAIR), quien impulsa la denominada «IA basada en objetivos» (Objective-Driven AI). LeCun sostiene que, para alcanzar una inteligencia verdadera, las máquinas deben aprender de forma autosupervisada observando el entorno, emulando el proceso de aprendizaje de un niño. Bajo esta premisa, se desarrollan arquitecturas capaces de predecir las consecuencias de sus acciones en un mundo físico, estableciendo una base de comprensión causal antes que lingüística.

En una línea convergente, laboratorios como Google Deep Mind y Open AI han orientado sus investigaciones hacia la creación de simuladores de alta fidelidad. Deep Mind, a través de proyectos como Genie 3, ha logrado generar entornos interactivos completos a partir de descripciones simples, priorizando la «IA encarnada» (Embodied AI) que aprende a navegar y manipular el espacio. Por su parte, OpenAI ha planteado que modelos de generación de video como Sora no son fines en sí mismos, sino instrumentos para que la IA interiorice leyes físicas básicas —como la fluidez, las colisiones y la permanencia de los objetos— al representar la realidad en movimiento.

El riesgo de habitar el mapa

Esta capacidad técnica nos devuelve a las advertencias de Jean Baudrillard sobre los simulacros. El filósofo francés señaló que nuestra cultura corría el riesgo de que «el mapa precediera al territorio»; es decir, que otorgáramos mayor entidad a las representaciones que a los hechos tangibles. Con los world models, esta idea adquiere una dimensión operativa.

Si una IA puede simular con exactitud el tráfico de una metrópoli o la dinámica de una cadena de suministros, el sistema empezará a decidir basándose en su «sueño» digital. Para Baudrillard, el peligro radica en la instauración de una hiperrealidad, un estado donde perdemos el contacto con lo concreto porque el simulador es más eficiente, rápido y predecible que el mundo de carne y hueso. En este escenario, la realidad física queda supeditada a la eficiencia del modelo.

El conocimiento en la «infosfera»

Desde una perspectiva contemporánea, Luciano Floridi explica que habitamos una «infosfera», un espacio donde lo digital y lo físico resultan ya inseparables. Aquí, los modelos del mundo alteran nuestra gnoseología. Tradicionalmente, el conocimiento se cimentaba en la experiencia sensible; sabíamos que el fuego quema por el contacto o la observación directa. Sin embargo, en esta etapa, el conocimiento se genera mediante la validación de modelos abstractos.

Transitamos de un saber basado en la experiencia humana a uno fundamentado en la efectividad del cálculo

La IA aprende la dinámica de los fenómenos sin interactuar con ellos, solamente procesando flujos de datos. Esto redefine el concepto de verdad: si antes esta era la adecuación del intelecto a la cosa, ahora empieza a medirse por la capacidad del algoritmo para que su predicción no falle. Transitamos de un saber basado en la experiencia humana a uno fundamentado en la efectividad del cálculo.

La verdad interna frente al azar humano

Hilary Putnam, en su propuesta del «realismo interno», sugería que nuestras descripciones del mundo dependen de los esquemas conceptuales que empleamos. Los modelos del mundo funcionan como esquemas cerrados y autónomos. El conflicto surge cuando estos sistemas intentan organizar la vida social, la cual es esencialmente contingente y colmada de matices que escapan a la formalización matemática.

Un simulador puede ser óptimo para coordinar la robótica industrial, pero resulta limitado para interpretar la complejidad de un conflicto social o el sentimiento de una comunidad. Al delegar la gestión de lo cotidiano en estos modelos, se corre el riesgo de «limpiar» la realidad de todo aquello que sea azaroso o difícil de cuantificar. Lo que no es simulable termina por ser ignorado por el sistema, ajustando nuestra convivencia a lo previsible y reduciendo el margen para la libertad y la espontaneidad.

¿La delegación del juicio? Una necesaria discusión

Un punto crítico es la erosión de la capacidad de decisión. Si los modelos del mundo gestionan áreas sensibles como la salud, la seguridad o la economía, estamos entregando la voluntad a una infraestructura invisible. La decisión ya no se basa en valores éticos o trayectorias históricas, sino en qué escenario de la simulación ofrece menos riesgos.

Se produce así una delegación del juicio: el razonamiento propio es reemplazado por los resultados de una máquina que proyecta por nosotros. Esto diluye la responsabilidad; ante el error, no hay un autor claro, sino un resultado de una optimización fallida. El ciudadano, en consecuencia, corre el riesgo de convertirse en un espectador de procesos automatizados donde la convicción moral es desplazada por el cálculo de probabilidades. Inquietante y peligroso.

COMENTARIOS