Así usan los populistas la inteligencia artificial

La inteligencia artificial se ha convertido en una más de las herramientas para la desinformación y las ‘fake news’, una pieza extra para la polarización y la pérdida de confianza.

Artículo

Si quieres apoyar el periodismo de calidad y comprometido puedes hacerte socio de Ethic y recibir en tu casa los 4 números en papel que editamos al año a partir de una cuota mínima de 30 euros, (IVA y gastos de envío a ESPAÑA incluidos).

COLABORA2024

Artículo

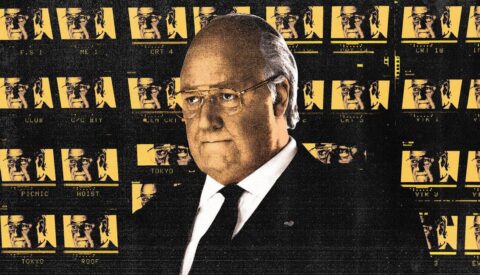

En las próximas elecciones estadounidenses, el voto de las mujeres y de las poblaciones negra y latina podría determinar la balanza. Llegar a ese electorado es crucial, y también mostrar que se cuenta con su apoyo. Unas fotografías que circularon por redes sociales intentaban hacerlo con el candidato republicano, Donald Trump. Trump aparecía sonriente, rodeado de un grupo de mujeres afroamericanas, en una imagen que podía leerse como que en realidad –y a pesar de lo que digan los análisis– sí tiene su apoyo.

El problema de las imágenes es que eran falsas: una investigación de la BBC descubrió que las fotos eran, en verdad, deep fakes creados con inteligencia artificial. La cadena pública británica ha concluido, de hecho, que estas imágenes y lo que implican son una de las tendencias emergentes de desinformación en la campaña presidencial del país. Las imágenes han circulado y han sido compartidas por los seguidores del candidato republicano.

Una investigación de la BBC descubrió que las fotos eran, en verdad, deep fakes creados con inteligencia artificial

La inteligencia artificial (IA en sus siglas en castellano, AI en las también muy usadas en inglés) no es una novedad, pero es en estos últimos años cuando su uso se ha desarrollado y popularizado, lo que ha generalizado las dudas sobre los efectos que puede llegar a tener. La IA está cambiando desde el mercado de trabajo hasta cuestiones tan sensibles como cómo se aplica o se gestiona la justicia, pero también ha impactado de lleno en la generación de contenidos. La IA permite generar contenidos creíbles en poco tiempo, algo que aprovechan también quienes tienen objetivos no exactamente legítimos.

La desinformación, las fake news o los bulos no son un problema nuevo, aunque en las últimas décadas se han enquistado y su alcance se ha multiplicado. Las redes sociales se han convertido en sus potentes altavoces, que hacen que las mentiras y las manipulaciones lleguen a audiencias millonarias en cuestión de segundos (sin que, en la mayoría de las ocasiones, los desmentidos a esas informaciones falsas lleguen a las mismas audiencias masivas). La victoria de Trump en 2016 o el Brexit han estado muy conectados con su impacto, como han ido demostrando las investigaciones sobre la cuestión.

Ahora, sin embargo, ya no se necesita a alguien que escriba esos contenidos o que piense esa estrategia, nacida a veces, simplemente, por su efecto económico: los titulares escandalosos generan clics y con ello ingresos por anuncios, como bien descubrió la fábrica de noticias falsas de la campaña estadounidense de 2016 en Macedonia. La inteligencia artificial puede hacer ese trabajo y de una manera que es incluso a veces más sofisticada que la versión anterior de la fabricación de bulos.

Por ello, la IA se ha convertido en un riesgo importante en términos de desinformación y, por ende, en polarización y auge de los populismos. Las fuentes especializadas ya advierten del riesgo que supone que se creen contenidos falsos con IA y que luego se lancen en grupos y sistemas de mensajería como WhatsApp o Telegram, más que en las redes sociales. Si en las redes sociales hay sistemas de control, en los canales operan en entornos cerrados en los que no se sabe qué ocurre y donde no hay quien los frene o los contradiga.

Aun así, los social media tampoco están exentos de problemas. X, la red social antes conocida como Twitter, eliminó sus sistemas de moderación tras la compra por parte de Elon Musk, y se ha convertido en un foco de desinformación y noticias falsas.

Un deep fake de la voz de Joe Biden pidió a los estadounidenses que no votasen en las primarias vía robocall

Todo esto tiene un efecto sobre la sociedad, uno que no es teórico ni potencial, sino que ya se está viendo. La inteligencia artificial ya está siendo empleada para alimentar bulos, crear informaciones falsas o dotar de pruebas –por muy falsas que sean– a las teorías conspiranoicas.

Como recuerda un artículo de El País, ya un deep fake de la voz de Joe Biden pidió a los estadounidenses que no votasen en las primarias vía robocall (llamadas de marketing masivas que hacen máquinas). Así mismo, vídeos y otros contenidos polarizaron las últimas elecciones en la India. Clonar medios es más fácil ahora que se pueden llenar de noticias redactadas por herramientas como ChatGPT.

Los efectos de la avanzadilla IA

Las consecuencias de este tipo de mensajes no son banales. Creerse las cosas que crea la inteligencia artificial es cada vez más fácil, como demuestran las veces que ya nos las ha colado en otras áreas. Separar qué es verdad y qué es mentira se vuelve más complejo y añade dificultades a un contexto que ya lo era bastante.

A eso se suma que la IA acentúa la pérdida de confianza entre la población. Si es cada vez más difícil saber qué es verdad y qué no lo es, qué creer y qué no, las personas optan por creer cada vez menos en todo. Los medios de comunicación legítimos y la información de calidad –que además muchas veces resultan grises, puesto que la realidad así lo es, frente a los titulares agresivos y las realidades telefilmescas y pasionales que crean las fake news– tienen mucho más complicado llegar a sus audiencias.

La desinformación –hecha o no por una IA– polariza la sociedad e impulsa visiones más radicales y agresivas. Los disturbios en Reino Unido de este verano son un ejemplo de ello: como explica un experto en la BBC, es muy difícil identificar quién los organizó porque detrás está toda la narrativa extremista que fue circulando por redes sociales y apps de forma desestructurada.

COMENTARIOS